AI bisa menghasilkan jawaban yang terdengar benar, terstruktur, dan meyakinkan, padahal informasinya salah atau bahkan tidak pernah ada. Fenomena ini punya nama resmi: AI hallucination.

Artikel ini menjelaskan apa itu AI hallucination, kenapa bisa terjadi, dan bagaimana cara mengenalinya dalam kehidupan sehari-hari.

Apa Itu AI Hallucination?

AI hallucination adalah kondisi di mana sistem AI menghasilkan informasi yang tidak akurat atau tidak ada dalam realita, namun menyampaikannya dengan nada percaya diri seolah-olah benar.

Ini bukan error dalam arti sistem rusak atau tidak berfungsi. Sistem berjalan normal. Hanya saja, output yang dihasilkan tidak sesuai fakta.

Contoh paling sederhana: Anda bertanya kepada AI tentang sebuah buku. AI menjawab dengan judul, nama pengarang, tahun terbit, dan ringkasan isi. Semuanya terdengar masuk akal. Tapi ketika dicek, buku itu tidak pernah ada.

Seberapa sering ini terjadi? Lebih sering dari yang banyak orang kira.

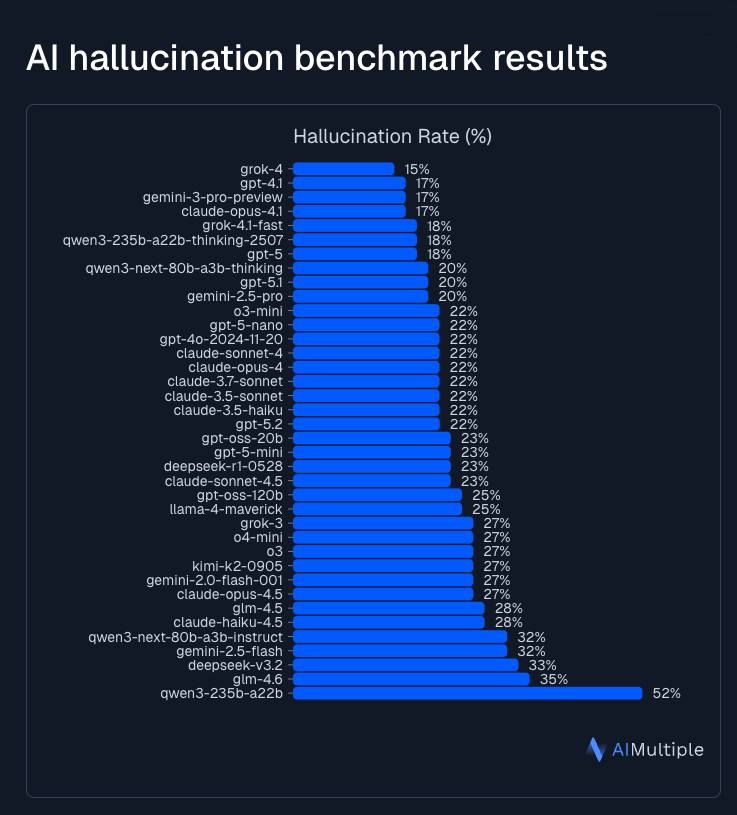

Berdasarkan benchmark yang dilakukan AIMultiple terhadap 37 model AI menggunakan 60 pertanyaan, bahkan model dengan performa terbaik sekalipun masih mencatat hallucination rate di atas 15%. Model dengan skor tertinggi mencapai 52%.

Sementara itu, survei Deloitte menemukan bahwa 77% bisnis menyatakan kekhawatiran serius terhadap risiko AI hallucination dalam operasional mereka.

Kenapa AI Bisa Melakukan Ini?

Untuk memahaminya, perlu dipahami satu hal mendasar tentang cara kerja AI: AI tidak mencari fakta. AI memprediksi kata.

Model AI seperti ChatGPT, Gemini, atau sejenisnya dibangun dengan cara mempelajari miliaran teks dari internet, buku, dan berbagai sumber lainnya.

Dari sana, AI belajar pola bahasa: kata apa yang biasanya muncul setelah kata tertentu, kalimat seperti apa yang terdengar masuk akal, dan bagaimana sebuah jawaban seharusnya disusun.

Ketika Anda mengajukan pertanyaan, AI tidak pergi “mencari” jawabannya. AI menghasilkan rangkaian kata yang paling mungkin benar berdasarkan pola yang sudah dipelajari.

Hasilnya terdengar koheren dan meyakinkan karena memang itulah yang dioptimalkan, bukan keakuratan faktualnya.

Tiga Alasan Utama Kenapa Hallucination Terjadi

1. AI belajar dari pola, bukan dari pemahaman

AI tidak benar-benar “mengerti” apa yang diucapkannya. AI mengenali bahwa susunan kata tertentu sering muncul bersama, lalu menggunakannya kembali. Untuk pertanyaan umum yang banyak tersedia di internet, ini biasanya menghasilkan jawaban yang tepat.

Untuk topik yang lebih spesifik atau jarang, AI tetap menghasilkan jawaban yang terdengar benar, meski faktanya meleset.

2. Data training punya batas waktu

Setiap model AI dilatih dari data yang dikumpulkan hingga waktu tertentu. Setelah itu, AI tidak tahu apa yang terjadi di dunia.

Jika Anda bertanya tentang berita terbaru, kebijakan yang baru berubah, atau riset yang baru diterbitkan, AI bisa saja menjawab berdasarkan informasi lama yang sudah tidak relevan.

3. AI tidak tahu batas kemampuannya sendiri

Ini yang paling penting. AI tidak memiliki mekanisme internal untuk mendeteksi kapan ia tidak tahu sesuatu. Tidak ada alarm yang berbunyi saat AI menjawab topik yang datanya terbatas. Akibatnya, AI menjawab pertanyaan sulit dengan tingkat kepercayaan diri yang sama seperti menjawab pertanyaan mudah.

Contoh Nyata yang Sering Terjadi

Statistik tanpa sumber

AI menyebut angka spesifik lengkap dengan nama lembaga riset yang terdengar kredibel. Ketika dicari, angka dan sumber itu tidak ditemukan di mana pun.

Tokoh nyata dengan informasi yang salah

AI mendeskripsikan profil seseorang dengan detail: jabatan, latar belakang pendidikan, karya yang pernah dibuat. Sebagian informasinya benar, sebagian lainnya adalah kombinasi dari profil orang lain yang mirip.

Referensi yang tidak pernah ada

AI merekomendasikan buku, artikel ilmiah, atau laporan lengkap dengan judul dan nama pengarang. Semuanya tidak dapat ditemukan karena memang tidak pernah diterbitkan.

Error itu kelihatan salah. Hallucination kelihatan benar. Itulah yang membuatnya perlu diwaspadai.

Bagaimana Cara Mengenali dan Menyikapinya?

Tidak ada cara untuk sepenuhnya mencegah hallucination, tapi ada beberapa langkah sederhana yang bisa dilakukan:

- Verifikasi klaim faktual. Angka, nama, tanggal, dan referensi yang disebutkan AI sebaiknya dicek ke sumber aslinya sebelum digunakan.

- Pertanyaan spesifik menghasilkan jawaban lebih terkontrol. Semakin sempit dan jelas pertanyaan Anda, semakin kecil ruang bagi AI untuk mengisi celah dengan informasi yang tidak akurat.

- Jangan anggap kepercayaan diri AI sebagai tanda kebenaran. AI yang menjawab dengan nada pasti bukan berarti jawabannya pasti benar.

Bacaan Penting: Waspada Halusinasi AI untuk Brand Anda

Kesimpulan

AI hallucination terjadi bukan karena sistemnya rusak, tapi karena cara AI bekerja memang bukan untuk mencari fakta, melainkan untuk menghasilkan teks yang masuk akal.

Memahami perbedaan ini adalah langkah pertama untuk menggunakan AI dengan lebih bijak.

AI adalah alat yang sangat berguna. Dan seperti alat lainnya, hasilnya bergantung pada seberapa baik Anda memahami cara kerjanya.

Bram is an SEO Specialist at Olakses with a background in Software Engineering and 10 years of experience in the field. His technical expertise and in-depth understanding of search engine algorithms enable him to develop strategies that drive organic growth and improve website performance